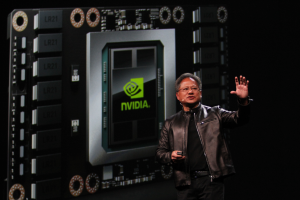

« Chez Nvidia, nous avons une règle. Aucun projet ne devrait reposer seulement sur trois miracles », a lancé le CEO du fabricant de puces américain Jen-Hsun Huang lors de sa dernière conférence GTC qui s'est tenue mardi 5 avril à San José, en Californie. « Tesla P100 repose sur 5 miracles ». Basée sur une batterie de composants et technologies de dernière génération - dont son dernier GPU sous architecture Pascal, GP100 - la carte Tesla P100 vient d'entrer dans une phase de production de masse. Elle commencera à équiper les serveurs destinés aux datacenters à partir du premier trimestre 2017.

Sur le papier, les spécificités techniques du circuit graphique Pascal (GP100) sont impressionnantes. Grâce à une finesse de gravure de 16mm, Nvidia a pu y faire tenir environ 15 milliards de transistors sur une surface de 610 millimètres carrés, permettant à la carte Tesla P100 de délivrer une puissance de calcul de 5,3 teraflops en double virgule flottante, et 10,6 teraflops en simple virgule flottante. Autre atout de poids : la dernière puce de Nvidia embarque 16 Go de mémoire HBM (high-bandwidth memory), un type de mémoire très rapide qui a fait ses débuts avec le GPU Radeon Fury X. Mais la comparaison avec la puce d'AMD s'arrête là : alors que cette dernière se connecte à la mémoire via un bus composé de 384 fils, le circuit graphique sous architecture Pascal communique au travers de 4 000 fils permettant de décupler les performances.

Jusqu'à 3 840 coeurs CUDA, 240 unités de texture et 64 SM

L'architecture Pascal permet, grâce à une conception améliorant la répartition de l'espace, à la puce GP100 de contenir jusqu'à 3 840 coeurs CUDA, 240 unités de texture avec un maximum de 60 streaming multiprocesseurs (chaque SM ayant 64 coeurs CUDA et 4 unités de texture). Un monstre de puissance qui s'avère taillé pour les traitements de données en masse (big data), l'apprentissage machine et les calculs dans le domaine de l'intelligence artificielle.