Décidément, l’actualité est aux LLM. Invoquant les problèmes de confidentialité et de sécurité que posent les grands modèles de langage publics, Kinetica ajoute à sa base de données relationnelle un modèle LLM développé par ses soins pour générer des requêtes SQL à partir d'invites en langage naturel pour le traitement analytique en ligne (OLAP) et en temps réel. La société, qui tire plus de la moitié de son chiffre d'affaires d'organisations de défense américaines telles que le NORAD et l'armée de l'air, affirme que le LLM natif est plus sûr, qu'il est adapté à la syntaxe du système de gestion de la base de données et qu'il opère dans le périmètre du réseau du client.

Avec la publication de son LLM, Kinetica rejoint les rangs de tous les principaux fournisseurs de LLM ou de services d'IA générative - y compris IBM, AWS, Oracle, Microsoft, Google et Salesforce - qui affirment qu'ils conservent les données d'entreprise à l'intérieur de leurs conteneurs ou serveurs respectifs. Ces fournisseurs affirment également que les données des clients ne sont pas utilisées pour former de grands modèles de langage. En mai, Kinetica, qui propose sa base de données sous différentes formes (hébergée, SaaS et sur site), a déclaré qu'elle intégrerait ChatGPT d'OpenAI pour permettre aux développeurs d'utiliser le traitement du langage naturel pour effectuer des requêtes SQL. En outre, la société a déclaré qu'elle travaillait à ajouter d'autres modèles à ses offres de bases de données, y compris NeMo de Nvidia.

Pas de coût supplémentaire annoncé pour les clients

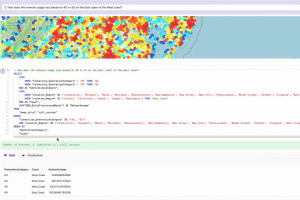

Le LLM de Kinetica donne également aux utilisateurs professionnels la possibilité de gérer d'autres tâches telles que les requêtes sur les graphiques de séries temporelles et les requêtes spatiales pour une meilleure prise de décision, a déclaré l'entreprise dans un communiqué. L'entreprise précise qu'il est immédiatement disponible pour les clients dans un environnement conteneurisé et sécurisé, sur site ou dans le cloud, sans aucun coût supplémentaire.