Le mieux est souvent d'ennemi du bien. C'est également le cas dans l'univers des LLM selon une recherche à laquelle plusieurs universitaires de Carnegie Mellon, Stanford, Harvard et Princeton ont participé. Alors qu'il est communément acquis que de grands modèles de langage pré-entraînés sur des tokens de plus en plus importants entraînent de meilleures performance, la réalité apparait beaucoup plus contrastée.

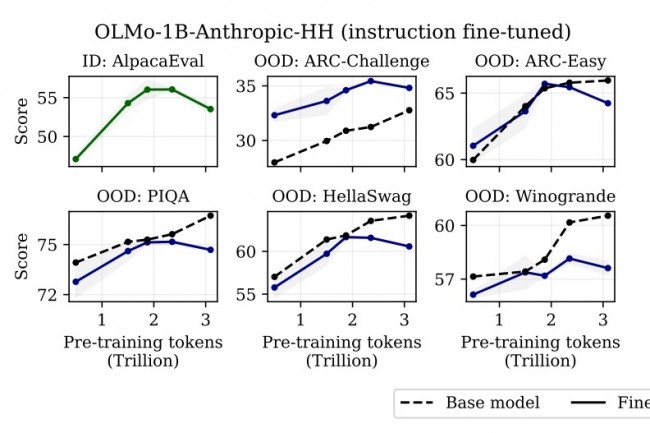

Dans leur étude, des chercheurs ont effet remis en question cette hypothèse en montrant qu'un pré-entraînement prolongé peut au contraire rendre les modèles plus difficiles à affiner, allant jusqu'à provoquer une dégradation des performances finales. Ce phénomène, qualifié de "surentraînement catastrophique" découle de la remise en cause d'une stratégie jusqu'alors largement adoptée consistant à augmenter la performance des modèles avec un pré-entrainement poussé. Or cela n'apparait pas toujours le cas : par exemple, le modèle OLMo-1B d'Anthropic pré-entraîné sur 3 trillions de tokens conduit selon les chercheurs à des performances inférieures de plus de 2 % à celles du même modèle ayant utilisé 2,3 trillions sur de nombreux benchmarks LLM standard.

"Grâce à des expériences contrôlées et à une analyse théorique, nous montrons que le surentraînement catastrophique résulte d'une augmentation systématique de la sensibilité générale des paramètres pré-entraînés aux modifications, y compris, mais sans s'y limiter, au fine tuning", peut-on lire dans le rapport. "Nos résultats appellent à une réévaluation critique de la conception du pré-entraînement qui prenne en compte l'adaptabilité en aval du modèle", font savoir les chercheurs.

Commentaire