« Aujourd'hui, nous présentons la disponibilité de Llama 2, la dernière génération de notre grand modèle de langue open source […] gratuit pour la recherche et l'utilisation commerciale ». Venant concurrencer le modèle de langage GPT-4 d’OpenAI, cette seconde version du modèle de Meta a été présentée en parallèle d'une annonce d'un partenariat avec Microsoft. Avec cet accord, le message est, on ne peut plus clair : devenir le grand modèle de langage de référence. C’est notamment pour cette raison que Meta a opté pour une « approche ouverte » qu’il considère comme étant « bonne pour le développement des modèles d'IA d'aujourd'hui, en particulier ceux de l'espace génératif où la technologie progresse rapidement ».

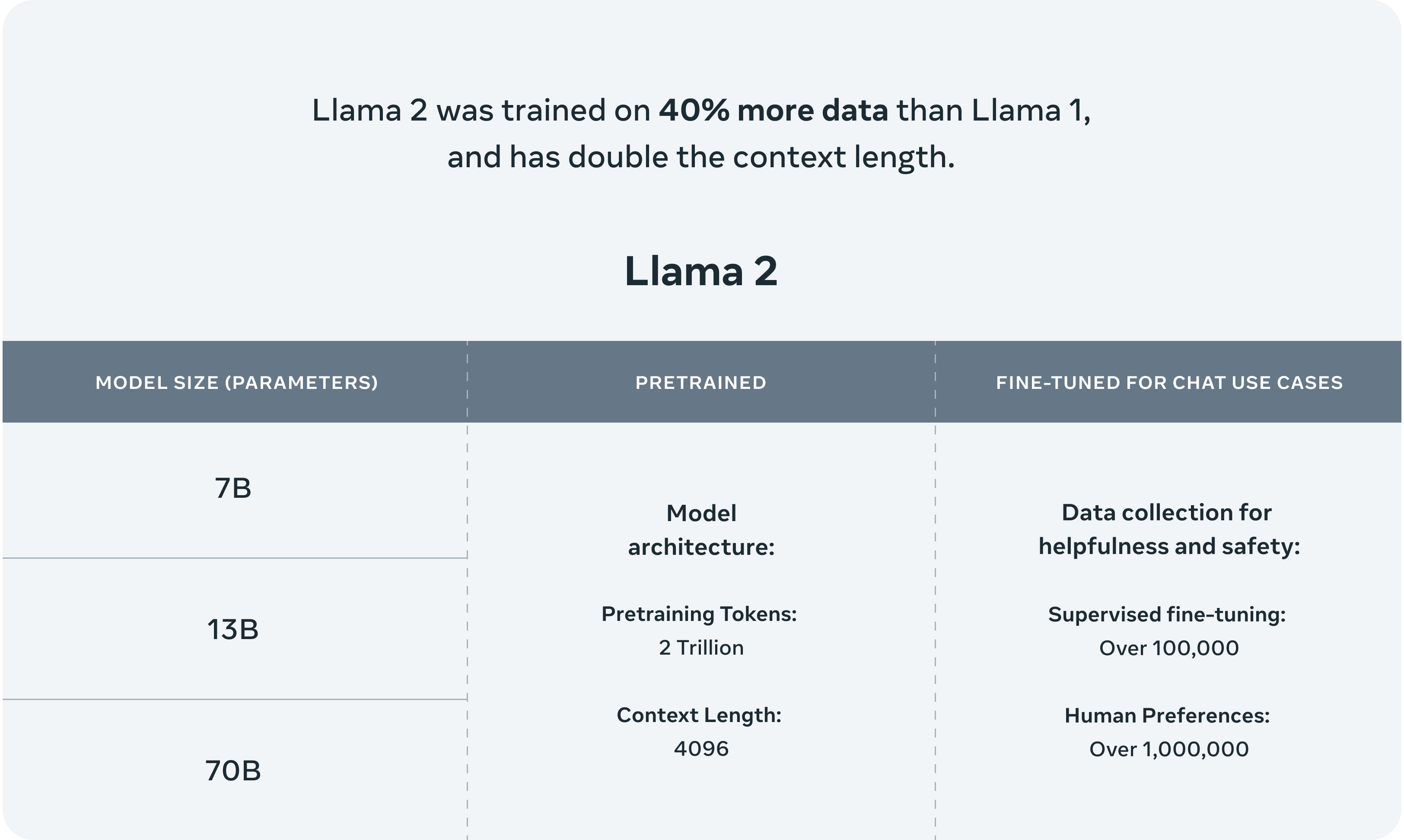

« En donnant aux entreprises, aux startups, aux entrepreneurs et aux chercheurs l'accès à des outils développés à l'échelle, avec l'appui d'une puissance de calcul à laquelle ils n'auraient pas accès autrement, nous leur ouvrons un monde d'opportunités pour expérimenter, innover et, en fin de compte, en tirer des avantages économiques et sociaux » précise la firme dans un communiqué. Meta poursuit en indiquant que ses équipes suivront attentivement les usages faits de Llama 2 afin d’en « tirer des enseignements, améliorer ces outils et corriger les vulnérabilités ». Revenant sur le succès rencontré par Llama 1 dans la communauté des chercheurs - avec plus de 100 000 demandes d'accès au grand modèle de langage – Meta indique que son successeur est fin prêt. Cette seconde version inclut donc des pondérations de modèle et un code de démarrage pour des modèles de langage Llama pré-entraînés et affinés, allant de 7 milliards à 70 milliards d'hyper-paramètres.

Microsoft : un pied dans chaque camp

S’il y a bien une entreprise qui profite de cet engouement autour des IA génératives et des grands modèles de langage, c’est bel et bien Microsoft. Lors de sa conférence Inspire, son CEO Satya Nadella a annoncé vouloir passer à la vitesse supérieure en faisant de Microsoft un partenaire privilégié pour Llama 2 et en développant ses efforts dans le domaine de l'IA générative. Investisseur de longue date dans OpenAI à qui l’on doit ChatGPT, la firme resserre aujourd’hui un peu plus ses liens avec Meta. À partir d'aujourd'hui, Llama 2 est disponible dans le catalogue de modèles Azure AI, offrant aux développeurs utilisant la plateforme cloud les moyens de construire avec ce modèle et de tirer parti des outils cloud-native pour le filtrage de contenu et les fonctions de sécurité. Notons que son concurrent, GPT-4, a également été formé sur les instances Azure AI comme le précise OpenAI : « L'infrastructure optimisée pour l'IA d'Azure nous permet également de fournir GPT-4 aux utilisateurs du monde entier ».

Il est également optimisé pour fonctionner localement sur Windows, offrant aux développeurs un flux de travail transparent lorsqu'ils proposent des expériences d'IA générative à leurs clients sur différentes plateformes. Llama 2 est disponible via Amazon Web Services (AWS), Hugging Face et d'autres fournisseurs. Après avoir introduit un écosystème ouvert pour des cadres d'IA interchangeables, et coécrit des articles de recherche pour faire avancer l'état de l'art en matière d'IA, les deux entreprises IT ont notamment collaboré à l'adoption de PyTorch - le principal framework d'IA créé par Meta et la communauté de l'IA - sur Azure. Microsoft et Meta font désormais front pour une approche ouverte des grands modèles de langage.

Les modèles pré-entraînés de Llama 2 sont entraînés sur 2 000 milliards de tokens et ont une longueur de contexte deux fois supérieure à celle de Llama 1. Ses modèles affinés ont été entraînés sur plus d'un million d'annotations humaines. (Crédit : Meta)

Un accent mis sur la sécurité pour éviter toute dérive du modèle

« Nous nous engageons à construire de manière responsable et fournissons un certain nombre de ressources pour aider ceux qui utilisent Llama 2 à faire de même ». Un engagement qui passe par différents exercices en équipe restreinte. Ainsi, les modèles affinés ont été soumis à des tests de sécurité par des équipes internes et externes. L'équipe a travaillé à la création de requêtes contradictoires pour faciliter la mise au point des modèles. En outre, il a été demandé à des tiers d'effectuer des tests contradictoires externes sur ses modèles afin d'identifier les lacunes en matière de performance. « Ces processus de mise au point de la sécurité sont itératifs ; nous continuerons à investir dans la sécurité par le biais de la mise au point et de l'analyse comparative et nous prévoyons de publier des modèles mis à jour et mis au point sur la base de ces efforts » précise Meta.

Un schéma de transparence a par ailleurs été publié. Ce dernier, disponible dans le document de recherche, révèle les défis et les problèmes connus rencontrés et donne un aperçu des mesures d'atténuation prises et de celles que les deux firmes ont l'intention d'explorer à l'avenir. Enfin, un guide de l'utilisation responsable a été créé pour aider les développeurs à appliquer les meilleures pratiques en matière de développement responsable et d'évaluation de la sécurité. Il décrit les meilleures pratiques qui reflètent les recherches actuelles et de pointe sur l'IA générative responsable. Cela s’accompagne d’une politique d'utilisation acceptable. Cette dernière interdit certains cas d'utilisation afin de garantir que ces modèles sont utilisés de manière équitable et responsable.

Commentaire