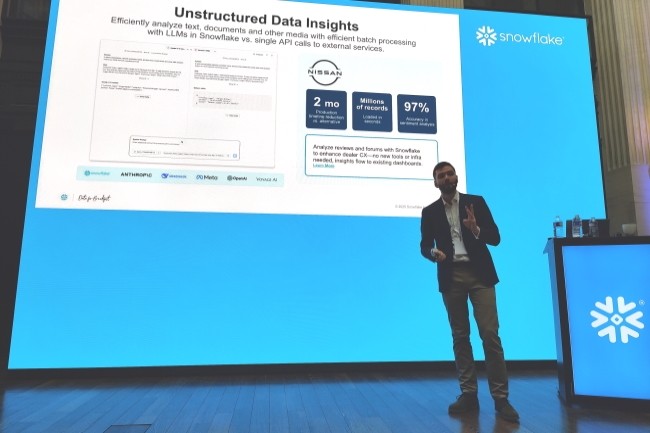

Le spécialiste du data store a organisé la dernière étape de son tour de France à Paris dans l’ancien siège du Crédit Lyonnais sur le grands boulevards. Un moment pour découvrir les dernières évolutions, mais aussi des retours des clients. Dans une présentation, Hugo Barret, solution manager engineering chez Snowflake, a donné quelques références comme « Nissan qui analyse des sentiments sur les éléments liés à la marque publiés sur Internet et les réseaux sociaux. Le projet a mis moins de deux mois à se mettre en place en se focalisant sur le rapatriement des données et fournir des traitements IA pour les data ingénieurs ». Dans un autre cas, « TravelPass, une application de voyage personnalisé, a migré son écosystème data de Databricks vers Snowflake, 30 To et 130 pipelines en un mois. A la cléef une réduction des coûts et des gains en efficacité opérationnelle », a précisé avec malice le responsable en référence à la concurrrence que se livre les deux fournisseurs de data store.

Massifier et analyser les données de la relation client

La matinée s’est poursuivie par l’intervention de Hubert Choplin, directeur data et CRM, et Sanyat Mohamed, data scientist, chez John Paul. Ce dernier est une filiale du groupe Accor, spécialisée dans trois domaines : la conciergerie, la création d’évènements exclusifs et des programmes de fidélisation (création de contenu et de newlsetter). La société comprend 280 concierges, 4 bureaux, 2 millions de membres actifs, 10 000 partenaires et un taux de satisfaction client de 90%. Et c’est bien sur ce dernier aspect de la relation client que John Paul s’est servi de Cortex AI de Snowflake. « Nous avons constaté que nous analysions très peu les interactions des concierges avec les clients. Nous avions des audits de qualité sur les appels, des retours sur les plaintes, mais par exemple sur la partie texte (mail, WhastApp…), il y avait moins d’analyse », explique Hubert Choplin. Il ajoute, « il n’y avait donc pas de consolidation des données et pas d’évaluation dans le temps des interactions cross-canaux ».

Hubert Choplin, directeur CRM et Data et Sanyat Mohamed, data scientis chez John Paul ont détaillé leur projet d'analyse des interactions clients avec les concierges. (Crédit Photo : JC)

Le dirigeant a regardé plusieurs outils existants dans le SI de John Paul, mais certains avec des manques (pas d’audio pour Salesforce, pas de speech to text pour Thoughspot) ou n’étaient pas conformes (Bedrock d’AWS). Il s’est donc tourné vers Snowflake, qui est « la source de données de confiance » au sein de la société et qui présentait plusieurs avantages, « les conversations écrites déjà disposition, pas de problème légal, les conversations audio ont été récupérées dans un stage [le format de stockage de Snowflake] ». Sanyat Mohamed ajoute « nous nous sommes servis de Whisper pour le speech to text via Snowpark Container Services. En combinaison avec Cortex AI, nous avons établi des tables pour chacun des canaux avec une table CRM, pour ensuite avec une table qualifiée de conversation ». Pour les métiers, la partie analytique est prise en charge par l’application Streamlit, start-up spécialisée dans le data sharing et rachetée en 2022 par Snowflake. « Les métiers l’on adopté rapidement pour avoir des retours sur les sentiments, les motifs d’interaction, des résumés de conversation écrite ou téléphonique, etc. », observe Hubert Choplin. Grâce à cette analyse massifiée, les bénéfices sont au rendez-vous selon le dirigeant, « environ 15 heures gagnées, une analyse maintenant de 100% des conversations sur l’ensemble des canaux et une seule application Streamlit ». Il regarde maintenant vers l’avenir avec « le développement d’une customer identity card permettant d’avoir des informations pertinentes quand on lance une conversation avec un client ».

Moderniser une plateforme d’analyse des données IoT

Si l’IA reste la tendance du moment, le second client à monter sur scène, Proxyserve se concentre sur la data dans le monde de l’IoT. Il a plusieurs métiers auprès des gestionnaires d’immeubles, de propriétaires ou de bailleurs sociaux en s’occupant de chauffage, de maintenance (électricité, VMC,..), de la fourniture et de la gestion de l’électricité, et enfin du comptage avec la télérelève des compteurs communicants (eau principalement). Et c’est sur ce point que le DSI, Sylvain Bourdette a retenu Snowflake. « Tout est parti d’un problème d’obsolescence logicielle. Pour la remontée d’informations, nous étions partis il y a quelques années sur une plateforme Hadoop/Cloudera qui s’est révélée vieillissante, accidentogène (un incident par jour) et qui ne crée pas de valeur », se souvient le dirigeant. Accompagné par Orange Business, il décide de changer et d’essayer Snowflake avec plusieurs critères « combien avons-nous besoin de stockage ? est-ce que la plateforme est scalable ? Ce choix sera-t-il encore bon dans les dix prochaines années ? ».

Sylvain Bourdette, DSI de Proxyserve, a évoqué la migration d'une plateforme Hadoop Cloudera vers Snowflake. (Crédit Photo : JC)

Un Poc a donc été mis en place avec un stockage des données brutes dans Azure puis un traitement dans la data platform de Snowflake. « Ce test nous a permis de nous rassurer sur les différents critères avec des vrais gains de performance, une stabilité opérationnelle et nous avons créé de la valeur. Par exemple, les alertes pour une fuite prenaient deux jours, maintenant c’est du quasi temps réel », souligne Sylvain Bourdelle. Il n’hésite pas non plus à donner le coût du projet, « toute la partie build comprenant la migration Hadoop vers Snowflake a coûté plus de 375 000 euros. Sur la partie run, nous avons même fait un gain de 10 000 euros ». Pour le futur, Proxyserve regarde l’intégration de Snowpipe et des tables dynamiques en 2026. La nouvelle plateforme servira aussi de fondation pour des cas d’usage IA. Comme quoi l’IA n’est jamais très loin même dans l’IoT.

Commentaire