Les mises à jour des grands modèles de langage donnent le tournis. Fraichement débarqués fin octobre, les grands modèles d'IA Granite 3 d'IBM ont déjà des successeurs. Big blue annonce ainsi que sa dernière salve de mises à jour 3.1 - toujours sous licence open source Apache 2.0 - apporte une série d'améliorations, d'ajouts et de capacités. Objectif ? Accroître les performances (RAG, workloads d'IA taillés pour la création d'agents...), la précision tout en bénéficiant davantage de garde-fous pour éviter les dérives (hallucinations, biais...). Le fournisseur indique qu'il continuera à publier des modèles et des fonctionnalités pour la série Granite 3 dans les mois à venir, avec de prochaines capacités multimodales prévues dès le premier trimestre 2025.

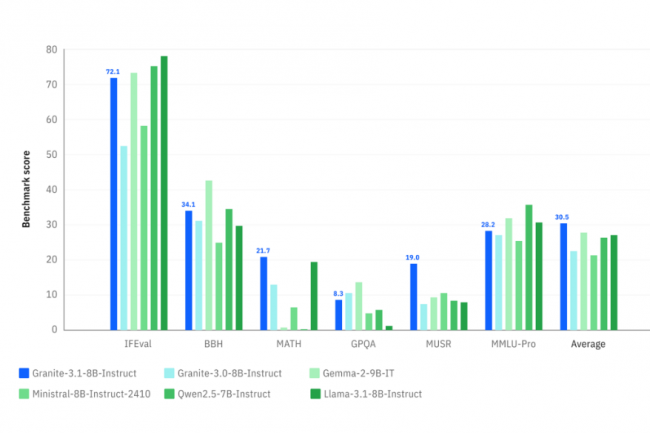

Parmi les membres de la famille Granite 3.1, on retiendra l'arrivée des LLM 8B et 2B, ainsi que Guardian 8B et 2B. Par rapport à Granite 3.0, une amélioration significative des performances du dernier modèle 8B est réalisée sur toute une série de benchmarks comme IFEval (capacité à suivre des instructions détaillées), et Multi-step Soft Reasoning et MuSR (capacité de raisonnement et de compréhension de textes longs, pour une fenêtre contextuelle de 128 000 tokens. Les modèles Granite 3.1 8B et 2B sont disponibles sur watsonx.ai et d'autres plateformes partenaires (DockerHub GenAI catalog, Hugging Face, LM Studio, Ollama...) De leur côté, Guardian 3.1 8B et 2B "peuvent désormais détecter les hallucinations susceptibles de se produire dans un flux de travail d'agent en accordant à l'appel de fonction la même responsabilité et la même confiance que celles que nous accordons déjà au RAG", fait savoir IBM. Ces derniers sont pour l'instant uniquement disponibles sur Hugging Face, très bientôt (fin décembre) sur Ollama et en janvier 2025 sur watsonx.ai.

Un LLM Granite Embedding multilingue jusqu'à 278 millions de paramètres

D'autres modèles d'IBM sont aussi de la partie. A savoir les LLM Granite Embedding, évolutions de la famille Slate de modèles linguistiques basés sur RoBERTA fonctionnant uniquement avec un encodeur : 30 et 125 millions de paramètres (anglais), ainsi que 107 et 278 millions de paramètres (multilingue). Comme leurs homologues, ces derniers offrent aussi une prise en charge de 12 langues (anglais, allemand, espagnol, français, japonais, portugais, arabe, tchèque, italien, coréen, néerlandais et chinois.)

Et sur la partie droit d'auteur, IBM applique "la même indemnité non plafonnée pour les réclamations de propriété intellectuelle de tiers que celle prévue pour l'utilisation d'autres modèles développés par IBM".

Commentaire