12% des entreprises utiliseraient l’intelligence artificielle (IA) pour remplacer des employés mais 60% d’entre elles préféreraient y avoir recours pour aider les équipes et non s’y substituer. C’est le résultat d’une enquête du cabinet Deloitte menée en 2020 auprès de 1300 DSI et responsables technologiques de haut niveau, L’IA serait en passe de devenir davantage un outil de collaboration entre humains et machines qu’un levier de suppression d’emplois. « Ceux qui ne perdront pas leur poste à cause de l’automatisation travailleront de plus en plus en collaboration avec des systèmes intelligents, confirme J.P. Gownder, vice-président et analyste principal pour le cabinet Forrester sur des sujets comme le futur du travail, l’IA, la réalité virtuelle, etc. Et c’est applicable à la quasi-totalité des processus imaginables. »

Design industriel collaboratif

Le generative design est un des exemples déjà concrets de collaboration entre humains et IA en entreprise. Le designer ou l’ingénieur de bureau d’étude alimente un algorithme avec des données telles que le type de matériau, la performance recherchée, les coûts, etc. L’IA les digère et propose un éventail très large de modèles parmi lesquels piocher. Parmi ces résultats, certains peuvent ne pas correspondre à l’esthétique habituelle des designs « humains », et auraient pu être écartés par l’équipe pour cette raison, alors qu’ils répondent parfaitement aux exigences édictées.

Pour Seth Hindman, strategy manager generative design et machine learning chez Autodesk, il s’agit de débarrasser les ingénieurs de fastidieuses itérations. « Ils n’ont ni le temps ni le goût d’explorer tout le spectre de possibilités d’un même design, explique-t-il. Il s’agit de permettre à l’ingénieur de se focaliser de nouveau sur l’ingénierie ! » Refocaliser les employés sur le cœur de leur métier en les débarrassant des tâches rébarbatives et répétitives. Cet argument souvent avancé pour justifier l’usage de l’IA prend un vrai sens dans ce cadre. Le generative design est apparu au sein de la R&D chez Autodesk qui l’a testé chez Airbus pour concevoir des composants légers ou avec le designer Philippe Starck pour une collection de chaises pour Kartell. Aujourd’hui, c’est une partie intégrante de la solution Fusion 360.

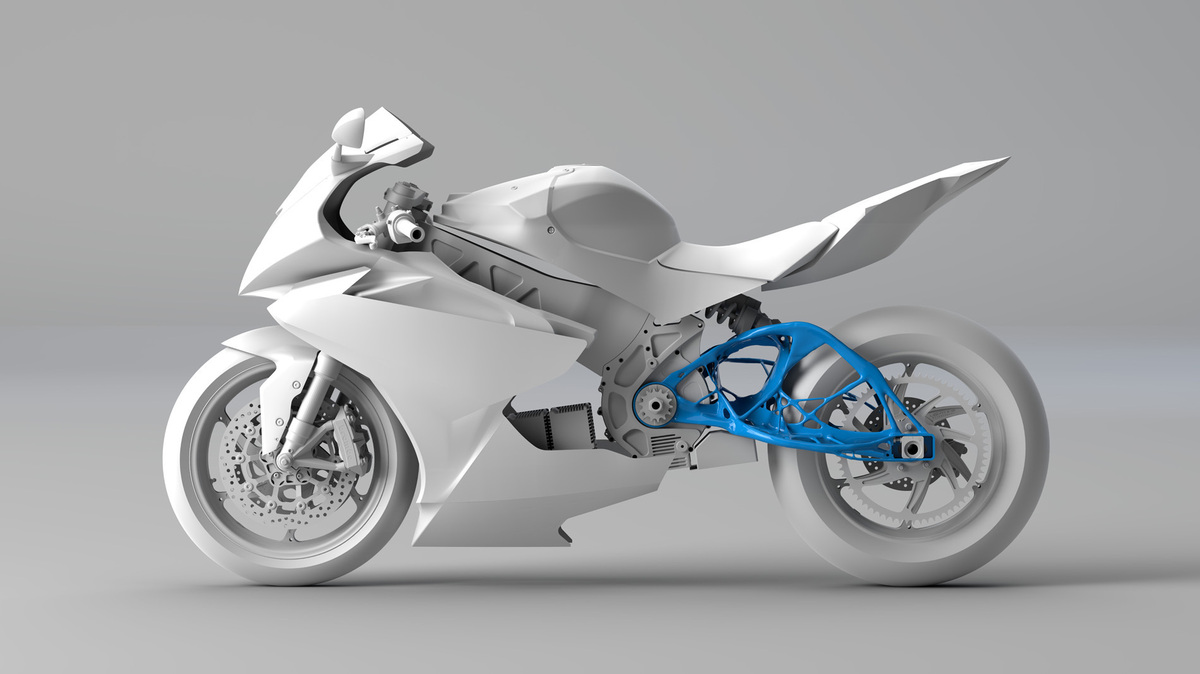

Le generative design d'Autodesk accompagne les ingénieurs de Lightning Motorcycles pour la conception de certaines pièces (Photo Lightning Motorcycles).

Des designs contre-intuitifs et pourtant performants

Le petit fabricant californien de motos électriques Lightning Motorcycles fait partie des utilisateurs. Pour concevoir une nouvelle pièce, ses ingénieurs devaient jusque-là passer en revue les différentes spécifications comme la résistance par exemple avant de modifier le design résultant pour l’améliorer, puis de recommencer. « Le generative design réalise des millions d’itérations et de simulation de ce type à grande vitesse, raconte le CEO fondateur, Richard Hatfield. Un énorme bond en avant. » En l’occurrence, la PMI se donne ainsi les moyens de jouer dans la même cour que des concurrents bien plus imposants que lui. Alexandre Martin, product designer pour le studio autrichien Edera Safety estime de son côté que la collaboration avec l’IA permet de considérer de nouveaux types de design qui seraient apparus contre-intuitifs. L’intelligence artificielle me propose des itérations que j’aurais jugées illogiques ou que j’aurais tout simplement évincées. C’est devenu une étape logique du processus de design. »

L’IA, coach de la relation client

Mais de nombreux travailleurs dans le monde interagissent déjà au quotidien encore plus directement avec une IA, parfois sans s’en rendre compte. Il suffit d’évoquer la traduction automatique ou les suggestions de réponses automatisées. Même les assistants vocaux familiers de nos foyers (Alexa, Siri, Google Assistant, Cortana…) de plus en plus présents dans les bureaux aident les employés à organiser une réunion, par exemple. Les algorithmes de Google ou d’Amazon derrière ses équipements ont inspiré des agents logiciels pour la relation client. Ils sont aux côtés des employés pour informer le consommateur ou jauger de son état d’esprit et lui donner la réponse adaptée. Plutôt qu’une automatisation complète de l’échange avec le client, ces bots collaborent avec l’agent pour une réponse adaptée au consommateur correspondant à son état d’esprit du moment et à la situation. Objectif : un meilleur service, une satisfaction client augmentée et une augmentation conséquente des ventes.

Anticiper les gestes pour mieux les accompagner

Le bureau n’est pas le seul lieu d’épanouissement de ces nouveaux collègues algorithmiques. Les cobots (collaborative robots) sont omniprésents dans les usines et les entrepôts. Ils aident les opérateurs à porter de lourdes charges ou à prélever les articles pour préparer une commande à livrer. Les IA conçues pour ses systèmes doivent interagir avec les humains de façon à la fois naturelle et fiable, ce qui exige anticipation et adaptation aux besoins.

Ainsi, les travaux de Julie Shah, professeure associée au département d’aéronautique et d’astronautique du MIT et directrice du groupe Interactive Robotics Group du Computer Science and Artificial Intelligence Laboratory, se concentrent-ils sur la façon dont les IA de ces robots peuvent interagir plus efficacement avec les travailleurs. Qu’il s’agisse de s’assurer que la machine fournit le bon matériau au bon moment sur une chaîne automobile ou de développer un système intelligent pour aider les personnes à prendre des décisions difficiles. « Toutes nos recherches concernent le développement d’une IA qui s’intègre parfaitement, comme une pièce de puzzle, avec les capacités de l’être humain. La clé de la réussite, c’est une technologie capable en quelque sorte de deviner les pensées de la personne, son état mental, ses prochaines actions et de s’insérer dans le déroulé des actions avec les bonnes informations, le bon matériau, la pièce détachée requise, au bon moment. » Ces systèmes cherchent à reproduire les processus complexes dans lesquels les humains sont experts, avec des algorithmes de prédiction et d’anticipation des mouvements des travailleurs, par exemple. « Ils doivent résoudre des problèmes de planification de l’allocation des tâches. Ce qui fait déjà tourner notre monde ! », résume Julie Shah.

Le système doit non seulement être fiable mais digne de la confiance des employés humains (photo Geralt Altmann / Pixabay)

Le système doit non seulement être fiable mais digne de la confiance des employés humains (photo Geralt Altmann / Pixabay)

Un robot pour accompagner la planification à l'hôpital

Un des projets de recherche du MIT CSAIL étudie par ailleurs la capacité des humains à faire confiance à une IA sur leur lieu de travail. Les chercheurs ont équipé un robot Nao d’une IA pour qu’il fasse des suggestions de planning aux personnels d’un hôpital. Un process dans lequel des décisions sont prises chaque seconde. L’algorithme fait des recommandations d’allocation de salle et d’affectation d’infirmiers pour des procédures de césarienne, par exemple. L’infirmier en chef qui s’en occupe, coordonne 10 infirmiers, 20 patients et 20 salles et tient compte d’un imposant nombre de variables. Il doit anticiper des facteurs comme le moment où une femme en travail va arriver et combien de temps cela va durer. « Ils ne jouent rien moins que le rôle d’un aiguilleur du ciel, estime Julie Shah. L’IA de Nao est donc entrainée à répliquer ce travail, raconte la chercheuse. L’infirmier en chef pouvait interroger le robot qui lui soumettait alors des suggestions en text-to-speech. En phase pilote, neuf fois sur dix, les employés de l’hôpital ont accepté les conseils de Nao. Ils ont aussi rejeté avec le même taux les suggestions jugées de faible qualité. Mais les retours ont été globalement positifs.

Développer des systèmes fiables et surtout dignes de confiance

Au fur et à mesure que la collaboration entre IA et humain s’intensifie dans le monde du travail, les entreprises peuvent décemment s’interroger sur la pertinence de s’appuyer plus sur l’un que sur l’autre. Pour Susan Athey, professeure d'économie de la technologie à la Stanford Graduate School of Business et directrice associée du Stanford Institute for Human-Centered Artificial Intelligence, chacun a ses atouts. Une IA va contourner certains des préjugés dont un humain ne sera pas conscient. « L'algorithme peut intégrer des informations dont la collecte serait lourde pour l'humain, précise-t-elle. Un humain qui lit un CV peut avoir un regard stéréotypé à propos d'une petite université, par exemple. Une IA, elle, proposera une évaluation plus précise de l’établissement. Avec sa capacité à collecter et analyser un plus grand nombre de données, elle identifiera peut-être un programme d'ingénierie très sélectif, par exemple, ce que l'humain n’aura pas eu le temps de vérifier. »

A contrario, les algorithmes d'IA sont faillibles et susceptibles de biais involontaires inscrits dans le code. Pour assurer l’adhésion des humains à une collaboration avec les algorithmes, la transparence est donc essentielle. Pas question qu’ils changent systématiquement les décisions humaines avec lesquelles ils ne sont pas d'accord, par exemple. « C’est contextuel, continue Susan Athey. Il faut concevoir des algorithmes qui communiquent suffisamment d'informations pour que les humains décident s'ils doivent écouter l’IA plutôt qu’eux-mêmes, et comprennent comment intégrer les informations proposées par l'algorithme.» Mais Julie Shah fait valoir de son côté, qu’un système fiable n’équivaut pas à un système digne de confiance. Dans l’industrie aéronautique, par exemple, de nombreux accidents sont dus à la dépendance des pilotes à des systèmes d’automatisation imparfaits.

Doter l’IA des moyens de connaître ses limites

« Il est relativement facile de susciter artificiellement de la confiance dans un système. En forçant sur l’anthropomorphisme, par exemple. Une IA qui parle est plus attirante que celle qui vous donne des instructions écrites à lire. » Pour la chercheuse, ce n’est pas la bonne méthode. Il faut donner à l’IA les moyens de comprendre quand il prend des décisions dans les limites de ses compétences et quand il sort de ces limites. La personne peut alors améliorer les capacités de la machine. « Nous nous demandons souvent dans quelle mesure une personne est disposée à faire confiance au système. Ce n’est pas la bonne question. Il faut se demander si le système est digne de confiance. C’est la différence entre un système fiable et un système digne de confiance. »

La formation sera un outil indispensable pour accompagner les employés qui collaboreront avec les IA (Photo Geralt Altmann / Pixabay)

Par ailleurs, il n'est pas techniquement possible d’automatiser toutes les tâches réalisées par les humains, car ils sont nettement plus performants dans certaines fonctions. Leur intuition pour résoudre des problèmes jamais rencontrés auparavant, en s'appuyant sur des informations provenant de diverses sources, est un atout par rapport la machine. « Les humains peuvent très bien extrapoler des circonstances qu’ils n’ont pas vues auparavant parce qu’ils ont beaucoup de bon sens, résume Susan Athey. Ils savent s’assurer que leurs prédictions ne sont pas complètement erronées tandis qu'une IA ne s’appuie que sur les données dont elle dispose. En revanche, elle excelle dans le traitement de très grands volumes de données qui satureraient rapidement un cerveau humain. »

L’urgence : acculturer et former

Pour J.P. Gownder de Forrester, dans le cas où une entreprise trouve un intérêt à déployer de l’IA collaborative, elle doit activement soutenir les salariés qui interagiront plus fréquemment avec les algorithmes. « Il faut se demander s’ils ont la culture, les compétences et l’envie de travailler avec des logiciels de plus en plus intelligents, » insiste-t-il. 59% des sociétés estiment important de repenser les emplois pour intégrer l'IA dans les 12 à 18 prochains mois, selon l'étude Deloitte, mais seuls 7% se disent prêtes à le faire. Mais seule une petite proportion des personnes interrogées (17%) investit dans la transformation des compétences. Pour l’analyste, « si beaucoup de sociétés considèrent encore l’IA est comme une technologie d’avant-garde, toutes vont devoir rapidement s’y intéresser de près. »

L’usage omniprésent et invisible de l’intelligence Artificielle en entreprise soulèvera de nombreuses préoccupations en matière d d’éthique :

Signaler un abus- déshumanisation de prises de décision,

- dérive du monitoring par surveillance algorithmique des tâches

- exploitation des données personnelles,

- etc.