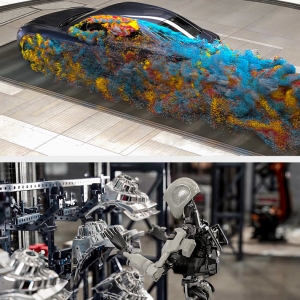

Quelques semaines après l’annonce de l’architecture GPU Ampere, Nvidia commercialise les premières cartes accélératrices A100 au format PCIe 4.0, consommant 250 watts. Vendue 9200 €HT, l’A100 PCIe, dépourvue de sortie vidéo puisqu’elle se destine au calcul intensif (modélisation et simulation 3D mais aussi traitements AI) repose sur un circuit GA100 gravé en 7 nm chez TSMC. C’est le site de vente en ligne britannique Server Factory qui a référencé ce produit disposant de 6912 coeurs Cuda, 432 coeurs Tensor de 3e génération et de 40 Go de mémoire HBM2e interfacées en 6144 bit, pour une bande passante maximale de 1,55 To/s (souvent arrondi à 1,6 To / s).

Selon Nvidia, avec les Tensor Gen3 et les capacités sparsity, les GPU A100 offrent jusqu'à 20 fois plus de performances que le GPU de la génération précédente Volta. Soit près de 19,5 TFLOPs en FP32 et 9,7 TFLOPS en FP64. Mais la carte A100 PCIe arrive avec des horloges inférieures pour réduire son enveloppe thermique. L'accélérateur A100 PCIe (250 watts) peut fournir 90% des performances de la carte A100 HGX (400 watts) dans les applications serveur les plus performantes. Cependant, dans des situations complexes qui nécessitaient des capacités de de calcul soutenues, le GPU 250 watts peut fournir de 90% à 50% les performances du GPU 400 watts. NVIDIA a déclaré que la baisse de 50% sera très rare et que seules quelques tâches peuvent pousser la carte à ce point. L’accélérateur GPU A100 PCIe de Nvidia est disponible pour différents cas d’usage : un système avec un seul GPU A100 PCIe ou des serveurs utilisant deux cartes en même temps via les 12 canaux NVLINK qui fournissent 600 Go / s d'interconnexion bande passante?

Disponible chez GCP

Nvidia a également annoncé hier la disponibilité de son GPU Ampere sur l'infrastructure cloud de Google. Plus précisément, c'est le circuit accélérateur A100 Tensor Core qui est proposé en version alpha dans le cadre de la famille d'instances VM (A2) optimisée pour l'accélération sur le service Compute Engine de Google. « Les clients de Google Cloud se tournent souvent vers nous pour fournir les derniers services matériels et logiciels afin de les aider à stimuler l'innovation sur l'IA et les charges de travail de calcul scientifique », a déclaré Manish Sainani, directeur de la gestion des produits chez Google Cloud. « Avec notre nouvelle famille A2 VM, nous sommes fiers d'être le premier grand fournisseur de cloud à commercialiser les GPU Nvidia A100, tout comme nous l'étions avec les GPU T4 de Nvidia. »

Bonjour

Signaler un abusQuelles recommandations avez vous pour l'environnement d'une telle carte ?

( carte mère, alim par exemple)